Les cartes RAID serveur occupent une place centrale dans la conception des infrastructures de stockage professionnelles, mais leur rôle est souvent confondu avec celui d'une carte HBA ou d'un contrôleur Tri-Mode. Pourtant, ces composants ne répondent pas aux mêmes objectifs techniques. Une carte RAID sert à construire des volumes logiques avec redondance, gestion de parité, cache d'écriture et mécanismes de tolérance de panne. Une carte HBA expose au contraire les disques de manière plus directe au système ou à une couche logicielle de stockage. Un contrôleur Tri-Mode ajoute une logique de convergence en permettant de gérer sur une même base matérielle des périphériques SAS, SATA et NVMe.

Dans un contexte B2B, le choix entre ces technologies ne dépend pas d'un simple critère de compatibilité ou de coût. Il engage la performance réelle, la capacité utile, la vitesse de reconstruction après panne, la qualité de la supervision et la souplesse d'évolution de la plateforme. Un mauvais dimensionnement du contrôleur RAID peut créer un goulet d'étranglement durable ou allonger dangereusement les fenêtres de risque en mode dégradé. À l'inverse, une architecture correctement choisie permet d'aligner les besoins applicatifs avec la bonne couche de contrôle du stockage.

Cet article explique clairement la différence entre cartes RAID serveur, contrôleur RAID, carte HBA et contrôleur Tri-Mode, puis détaille les cas d'usage où chaque approche devient pertinente. Il présente aussi les critères techniques à analyser avant achat : compatibilité disque et serveur, niveaux RAID, cache, connectique, évolutivité et support des environnements SAS, SATA et NVMe. L'objectif est de fournir une base de lecture utile à un décideur technique ou à un responsable infrastructure qui doit choisir un matériel RAID serveur sans approximation.

Qu'est-ce qu'une carte RAID serveur et à quoi sert-elle ?

Une carte RAID serveur est un contrôleur matériel installé dans un serveur afin d'orchestrer l'accès aux disques et de présenter au système d'exploitation un ou plusieurs volumes logiques cohérents. Dans une infrastructure professionnelle, son rôle ne se limite pas à relier des supports de stockage. Elle intervient dans la distribution des écritures, la reconstruction après panne, la gestion des parités, l'isolation des défaillances et la supervision des groupes de disques. Le matériel RAID serveur constitue donc une couche de contrôle entre les supports physiques et les applications, avec des impacts directs sur la disponibilité, la latence et la capacité utile.

Dans un serveur de production, le contrôleur RAID doit absorber des charges hétérogènes, parfois composées d'accès séquentiels soutenus, parfois d'IO aléatoires à faible profondeur de file, parfois encore d'écritures synchrones exigeantes. Une carte RAID serveur adapte ces flux en fonction du niveau RAID retenu, de la quantité de cache disponible, du nombre de disques actifs et de la nature des interfaces utilisées. Le résultat ne se résume jamais à une simple addition de débits. Les performances réelles dépendent de la manière dont le contrôleur RAID traite les files d'attente, gère les lectures de reconstruction et arbitre les priorités entre production et maintenance.

L'objectif principal reste la continuité de service. Selon l'architecture retenue, un volume peut tolérer la perte d'un ou plusieurs disques sans interruption immédiate d'exploitation. Cette tolérance de panne a un coût en capacité utile, en écritures supplémentaires et en temps de reconstruction. Plus les disques sont capacitifs, plus la fenêtre de risque pendant un rebuild devient critique. C'est pourquoi le choix d'un contrôleur RAID ne doit jamais être dissocié de la nature des charges, du profil de croissance, des contraintes de supervision et du niveau de criticité des données.

Fonctionnement d'un contrôleur RAID matériel

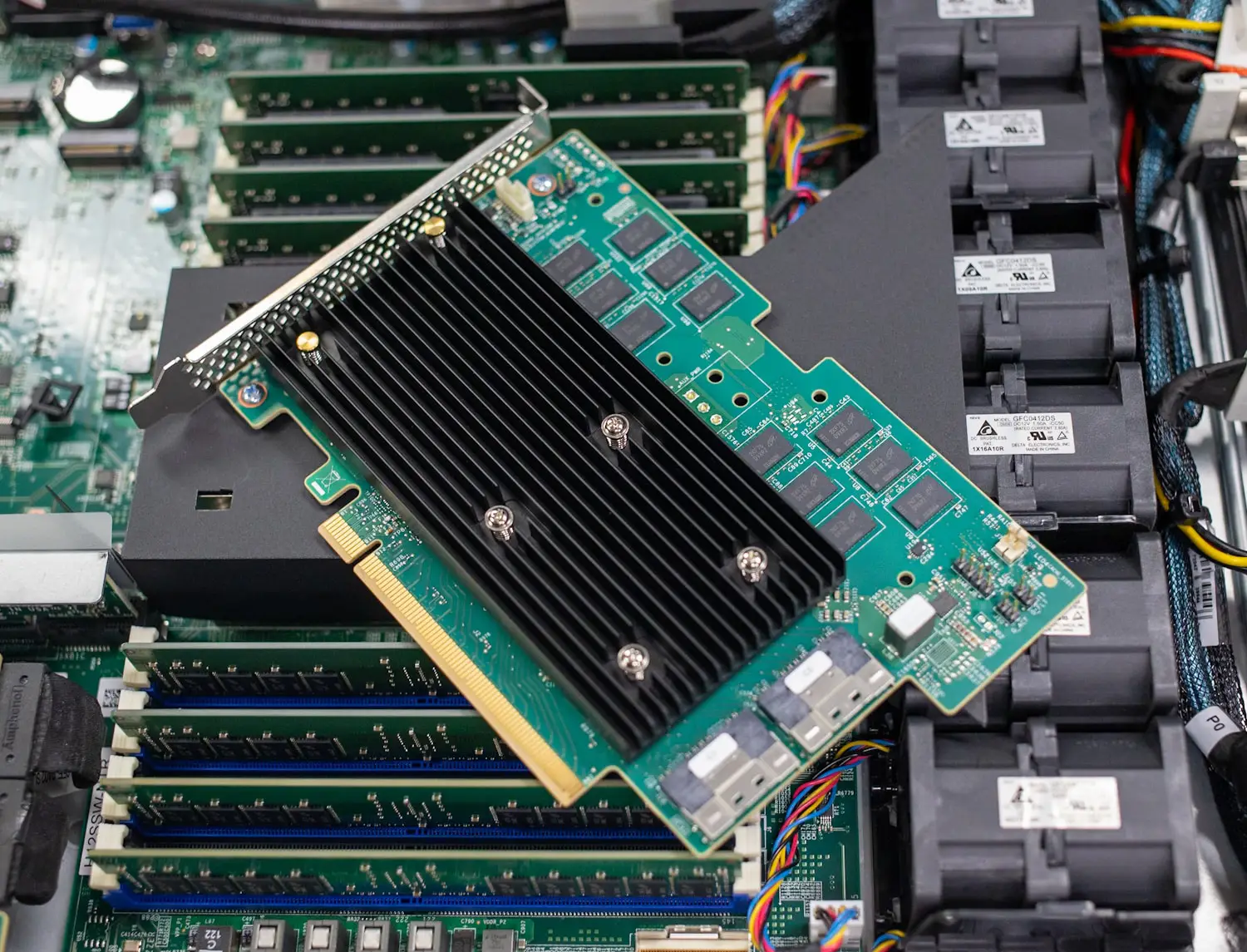

Un Un contrôleur RAID materiel embarque embarque son propre processeur d'entrée-sortie, sa logique de calcul RAID et, selon les modèles, une mémoire cache protégée par batterie ou supercondensateur. Il prend en charge localement les opérations de mirroring, de striping et de parité sans déléguer l'essentiel des calculs au CPU principal du serveur. Le système d'exploitation ne voit alors que des volumes logiques, tandis que la carte maintient la cartographie des blocs, l'état des disques et les métadonnées nécessaires à la reconstruction.

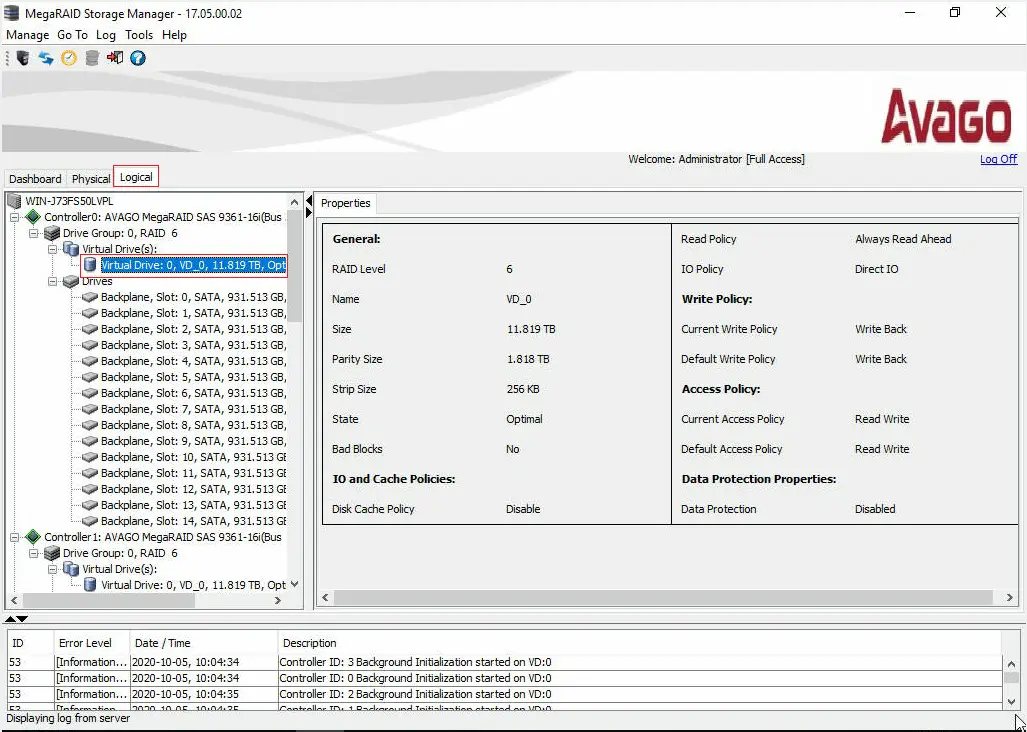

Lors d'une écriture, le contrôleur RAID décide comment répartir les blocs sur les disques membres selon le niveau RAID configuré. En RAID 1, il duplique les données sur plusieurs supports. En RAID 5 ou RAID 6, il calcule et distribue des informations de parité qui serviront à reconstituer les données en cas de perte d'un ou deux disques. Ce traitement introduit une surcouche logique qui peut améliorer la continuité de service, mais qui ajoute aussi des pénalités d'écriture et des contraintes de rebuild.

Le cache joue un rôle structurant. En lecture, il permet d'absorber des accès répétitifs. En écriture, il lisse les rafales d'IO et réduit le nombre d'opérations physiques immédiates sur les disques. Dans un environnement serveur, la protection de ce cache conditionne l'intégrité des transactions en cas de coupure d'alimentation.

Différence entre RAID matériel et RAID logiciel

La différence RAID et HBA ne doit pas être confondue avec la différence entre RAID matériel et RAID logiciel. Dans un RAID matériel, l'intelligence de gestion des groupes de disques réside principalement sur la carte. Dans un RAID logiciel, c'est le système d'exploitation ou une couche de stockage qui pilote directement les disques exposés, souvent via une carte HBA. Le premier modèle centralise la logique dans le contrôleur RAID, le second la déplace vers le CPU, la mémoire et les services du serveur.

Le RAID matériel apporte une abstraction stable, des fonctions de supervision intégrées et une mise en œuvre souvent plus simple dans des environnements standardisés. Il convient bien à des serveurs exigeant une administration prévisible, des temps d'initialisation courts et une compatibilité large avec les hyperviseurs ou systèmes généralistes. En contrepartie, il introduit une dépendance forte au matériel RAID serveur, à son firmware et à ses limites de cache ou de bande passante interne.

Le RAID logiciel offre davantage de souplesse pour des architectures où le stockage est piloté par des couches intelligentes, comme certains systèmes de fichiers avancés ou plateformes de virtualisation. Il peut être pertinent lorsque la visibilité disque par disque est requise. En revanche, sa performance réelle varie davantage selon la charge CPU, la qualité de l'implémentation logicielle et la discipline d'exploitation. Le choix dépend donc du niveau de contrôle souhaité, de la criticité des données et de l'architecture globale du stockage serveur SAS SATA NVMe.

Quelle différence entre une carte RAID, une carte HBA et un contrôleur Tri-Mode ?

Dans une architecture serveur, une carte RAID, une carte HBA et un contrôleur Tri-Mode n'occupent pas la même fonction, même si ces composants peuvent partager un format PCIe proche et des connectiques comparables. La confusion vient souvent du fait qu'ils s'intercalent tous entre le serveur et les baies de disques. Pourtant, leur logique d'exploitation, leur niveau d'abstraction et leur impact sur la pile de stockage sont différents. Comprendre cette distinction est indispensable avant de choisir un matériel RAID serveur adapté à une charge professionnelle.

Une carte RAID intègre des fonctions de création de volumes, de gestion de parité, de miroir, de reconstruction et parfois de cache protégé. Elle présente au système des volumes logiques déjà structurés. À l'inverse, ne carte HBA agit principalement comme un adaptateur d'hôte vers bus de stockage. Elle expose les disques de manière beaucoup plus directe, sans imposer nativement une logique RAID matérielle. Elle est donc fréquemment retenue lorsque l'intelligence de gestion doit rester au niveau du système, d'un hyperviseur ou d'une couche logicielle de stockage.

Le contrôleur Tri-Mode ajoute une autre dimension. Il ne désigne pas uniquement une fonction RAID, mais une capacité à gérer plusieurs protocoles de stockage serveur SAS SATA NVMe au sein d'une même base matérielle. Cette convergence répond à l'évolution des plateformes serveurs, où coexistent encore des disques SAS pour leur robustesse, des SSD SATA pour certains paliers de capacité et des SSD NVMe pour les charges à forte intensité transactionnelle. Selon les modèles, un contrôleur Tri-Mode peut fonctionner en mode RAID, en mode passthrough ou dans des configurations hybrides.

La différence RAID et HBA ne doit donc pas être réduite à une simple question de prix ou de marque. Elle relève d'un choix d'architecture : logique embarquée dans le contrôleur RAID, accès direct via carte HBA, ou convergence protocolaire via un contrôleur Tri-Mode.

Rôle d'une carte HBA dans une architecture serveur

Une carte HBA sert avant tout à relier proprement le serveur aux périphériques de stockage sans transformer ces derniers en volumes RAID matériels. Elle assure le transport des commandes entre le système et les disques ou tiroirs d'extension, tout en laissant la visibilité unitaire des supports au niveau logiciel. Cette approche est recherchée lorsque l'entreprise souhaite que le système d'exploitation, l'hyperviseur ou une plateforme de stockage décide lui-même de la protection des données, de la répartition des charges et de la reconstruction.

Dans ce modèle, la carte HBA n'apporte pas la même abstraction qu'un contrôleur RAID. Elle privilégie la transparence des chemins d'accès, la remontée d'informations précises sur les disques et une maîtrise directe des états individuels. Cela la rend pertinente dans des environnements où la couche logicielle de stockage doit piloter finement les supports, notamment pour la réplication, l'erasure coding, les pools distribués ou certains mécanismes de snapshots.

Le choix d'une HBA impose en contrepartie que la redondance, la cohérence des volumes et la tolérance de panne soient traitées ailleurs. Elle n'est donc pas un substitut automatique à une carte RAID serveur, mais un composant adapté aux architectures où le contrôle doit rester du côté logiciel.

Spécificités d'un contrôleur Tri-Mode pour SAS, SATA et NVMe

Un contrôleur Tri-Mode est conçu pour prendre en charge plusieurs familles de périphériques au sein d'une même plateforme, en particulier SAS, SATA et NVMe. Cette polyvalence modifie la conception du stockage serveur SAS SATA NVMe, car elle permet d'éviter la multiplication de cartes spécialisées et de rationaliser les chemins de connexion. Dans un serveur moderne, cela facilite l'intégration progressive de SSD NVMe tout en conservant des grappes SAS ou SATA déjà en production.

Sur le plan technique, cette convergence suppose une maîtrise de protocoles, de latences et de profils de files d'attente très différents. Le NVMe fonctionne avec un parallélisme bien plus important que SATA, tandis que SAS conserve des avantages en matière de dual-port, de robustesse de liaison et de gestion en environnement critique. Le contrôleur Tri-Mode doit donc arbitrer des comportements de périphériques hétérogènes sans devenir un point de contention.

Selon sa conception, il peut servir de contrôleur RAID, de passerelle de connectivité avancée ou de base pour une évolution progressive des serveurs. Son intérêt principal est d'apporter une trajectoire de transition. Une infrastructure peut ainsi faire coexister plusieurs générations de supports sans refonte immédiate du châssis, du câblage ou de la logique de gestion globale.

Dans quels cas faut-il choisir une carte RAID plutôt qu'une HBA ?

Le choix entre une carte RAID serveur et une carte HBA dépend d'abord de l'endroit où l'entreprise veut placer l'intelligence de protection des données. Une carte RAID est retenue lorsque la plateforme doit disposer d'une gestion embarquée des volumes, d'une tolérance de panne immédiate et d'une administration centralisée au niveau du contrôleur. Dans ce schéma, les disques sont regroupés en ensembles logiques stables, exposés au système sous une forme simplifiée. Cette approche reste pertinente pour des serveurs dont l'objectif principal est d'assurer un service prévisible, avec des temps d'indisponibilité limités et une exploitation standardisée.

Une carte HBA convient davantage lorsque le serveur doit voir les disques individuellement pour laisser une couche logicielle gérer la redondance, la distribution ou la reconstruction. Ce choix est fréquent dans des architectures logicielles de stockage, mais il n'est pas toujours optimal pour des environnements où la simplicité opérationnelle, la gestion du cache d'écriture et la supervision embarquée sont prioritaires. Dans un contexte où la criticité applicative est forte, une carte RAID peut réduire la complexité d'intégration et fournir un cadre plus direct pour exploiter des groupes de disques avec des niveaux RAID adaptés.

La bonne question n'est donc pas de savoir quel composant est le plus évolué dans l'absolu, mais quel modèle de contrôle répond aux contraintes réelles du serveur. Lorsqu'il faut combiner redondance, volumes logiques, maintien en exploitation après panne disque et comportement constant sous charge, le matériel RAID serveur conserve un avantage net. Lorsque la priorité est la visibilité complète des supports et l'orchestration par logiciel, la HBA devient plus logique. La différence RAID et HBA relève ainsi de l'architecture cible, et non d'une opposition simpliste entre ancien et moderne.

Besoins en performance, redondance et gestion des volumes

Une carte RAID devient prioritaire lorsque la plateforme exige une redondance native et une gestion stable des volumes sans dépendre directement de la charge CPU du serveur. Dans ce cas, le contrôleur RAID prend en charge les calculs de parité, les politiques d'écriture, les reconstructions et une partie de l'optimisation des accès disque. Cela permet de maintenir un comportement plus prévisible, notamment sur des charges mixtes combinant lectures aléatoires, écritures synchrones et opérations de maintenance.

Le besoin de capacité utile doit également être arbitré avec précision. Un RAID 1 sacrifie une partie importante de l'espace disponible, tandis qu'un RAID 5 ou RAID 6 réduit davantage la perte de capacité mais augmente la complexité des écritures et la durée potentielle des rebuilds. La carte RAID serveur permet de piloter ces compromis dans une logique de production plus directe, avec des outils de supervision, d'alerting et de gestion de l'état des groupes de disques.

Lorsque l'objectif est de présenter au système des volumes immédiatement exploitables, cohérents et protégés, une HBA seule ne suffit pas. Elle laisse ce travail à d'autres couches, ce qui peut être pertinent, mais pas toujours souhaitable dans un serveur où la simplification opérationnelle reste critique.

Cas d'usage en sauvegarde, stockage et virtualisation

Dans un serveur de sauvegarde, une carte RAID est souvent retenue lorsque les jeux de données doivent être stockés sur des volumes résistants à la panne disque, avec une administration locale simple et des fenêtres de sauvegarde prévisibles. Les flux de sauvegarde produisent souvent des écritures soutenues et des capacités importantes, ce qui impose de bien choisir le niveau RAID pour limiter à la fois le risque en reconstruction et la perte de capacité utile.

En stockage primaire, la carte RAID serveur reste pertinente pour des applications professionnelles qui attendent une présentation bloc classique, une haute disponibilité locale et un comportement stable sans surcouche logicielle complexe. Dans des environnements de virtualisation, elle peut aussi simplifier la mise à disposition de datastores protégés, surtout lorsque l'on cherche à maîtriser les temps de reprise et à isoler les incidents disque à l'intérieur du serveur ou du nœud.

À l'inverse, une HBA sera souvent choisie lorsque la virtualisation ou la couche de stockage distribuée doit gérer elle-même les disques bruts. Le choix d'une carte RAID plutôt qu'une HBA est donc justifié lorsque l'infrastructure privilégie la redondance embarquée, le contrôle local des volumes et une exploitation plus directe du stockage serveur SAS SATA NVMe.

Quels critères techniques faut-il analyser avant d'acheter un contrôleur RAID serveur ?

L'achat d'un contrôleur RAID serveur ne doit jamais être traité comme une simple question de nombre de ports ou de compatibilité théorique avec quelques disques. Dans une infrastructure professionnelle, ce composant conditionne la manière dont seront absorbées les charges, gérées les pannes, exploitée la capacité utile et maintenue l'évolutivité du stockage. Une erreur de sélection peut produire un goulet d'étranglement durable, une reconstruction trop longue, un manque de compatibilité avec certains supports ou une impossibilité d'étendre proprement la plateforme.

Le premier niveau d'analyse concerne le positionnement réel du contrôleur dans l'architecture. Il faut vérifier le type de serveur, le nombre de lignes PCIe disponibles, la génération du bus, la bande passante nécessaire et la nature des disques à connecter. Un contrôleur RAID adapté à des grappes SAS ne répond pas forcément aux exigences d'une plateforme mixte orientée stockage serveur SAS SATA NVMe. La compatibilité ne doit pas être comprise comme un simple démarrage possible, mais comme la capacité à exploiter les supports sans limitation structurelle de débit, de file d'attente ou de topologie.

Il faut ensuite examiner les fonctions embarquées : niveaux RAID pris en charge, volume de cache, protection du cache en cas de coupure, possibilités d'extension, gestion du hot spare, outils de supervision, et comportement en mode dégradé. Ces éléments ont un effet direct sur la tolérance de panne et sur les performances réelles. Un contrôleur RAID mal dimensionné peut rester correct en régime nominal puis devenir critique lors d'une reconstruction ou d'une montée en charge simultanée.

Enfin, le choix doit être aligné avec la durée de vie attendue de la plateforme. Un contrôleur dimensionné uniquement pour le besoin immédiat risque d'imposer un remplacement précoce si le nombre de disques, le type d'interfaces ou la densité de charge augmentent rapidement.

Compatibilité avec les disques, interfaces et serveurs

La compatibilité constitue le premier filtre technique. Il faut vérifier la prise en charge des familles de disques utilisées ou prévues, qu'il s'agisse de supports SAS, SATA ou NVMe, ainsi que la génération des interfaces et la topologie de connexion. Un contrôleur RAID peut annoncer un support large tout en limitant certaines fonctions selon le type de support, la densité du backplane ou le mode de fonctionnement choisi. Ce point est central dans le choix d'un matériel RAID serveur destiné à évoluer.

La compatibilité avec le serveur lui-même doit être examinée au même niveau. Format de carte, hauteur, dissipation thermique, lignes PCIe disponibles, firmware de la plateforme et validation constructeur influencent directement la stabilité d'exploitation. Une carte performante sur le papier peut être sous-exploitée si le châssis, le riser ou le backplane introduisent une contrainte structurelle.

Il faut également vérifier la compatibilité avec les systèmes d'exploitation, hyperviseurs et outils de supervision. Un contrôleur RAID n'est pleinement exploitable que si l'administration, les alertes, les états de disques et les événements de dégradation remontent correctement dans l'environnement cible.

Cache, niveaux RAID, connectique et évolutivité

Le cache est un critère structurant. Sa capacité, son mode d'utilisation et sa protection conditionnent la gestion des écritures, en particulier sur des charges transactionnelles ou des fenêtres de sauvegarde soutenues. Un cache non protégé peut exposer à un risque d'intégrité après coupure d'alimentation. À l'inverse, un cache correctement sécurisé permet au contrôleur RAID d'amortir une partie des pics de charge et d'optimiser la file d'attente des IO.

Les niveaux RAID supportés doivent être confrontés à la criticité des données, à la capacité utile recherchée et au temps acceptable de reconstruction. Il ne suffit pas qu'un niveau soit disponible. Il faut vérifier qu'il reste pertinent avec la taille des disques, le nombre de membres par groupe et le profil de charge attendu. Un RAID 5 sur des disques très capacitifs peut exposer à une fenêtre de risque trop large pendant le rebuild.

La connectique et l'évolutivité ferment l'analyse. Nombre de ports internes, possibilité d'extension externe, compatibilité expander, support du hot spare et trajectoire vers un contrôleur Tri-Mode doivent être évalués dès l'achat. C'est ce qui permet d'éviter un remplacement prématuré quand l'infrastructure prend de la densité.

Pourquoi les contrôleurs Tri-Mode deviennent-ils centraux dans les infrastructures serveur ?

Les contrôleurs Tri-Mode prennent une place centrale dans les infrastructures serveur parce qu'ils répondent à une contrainte devenue structurelle : faire coexister plusieurs générations de stockage sans fragmenter l'architecture matérielle. Dans de nombreux environnements, les entreprises exploitent encore des disques SAS pour des usages critiques, des SSD SATA pour certains équilibres capacité coût, et des SSD NVMe pour les charges sensibles à la latence. Multiplier les cartes spécialisées augmente la complexité d'intégration, les points de panne potentiels et les limites d'évolutivité. Le contrôleur Tri-Mode apporte une base unique pour absorber cette hétérogénéité.

Son intérêt ne tient pas uniquement à la compatibilité protocolaire. Il permet aussi de raisonner l'infrastructure en trajectoire de transformation plutôt qu'en remplacement brutal. Une plateforme peut conserver une partie de son stockage serveur SAS SATA NVMe existant, tout en ouvrant la voie à des supports plus rapides sur les mêmes serveurs ou les mêmes baies de connexion. Cette souplesse est importante dans les environnements où les cycles de renouvellement matériel ne sont pas parfaitement alignés entre châssis, backplanes, disques et applications.

Le contrôleur Tri-Mode devient également central parce qu'il réduit certains effets de silos. Les équipes n'ont plus à raisonner avec une logique complètement séparée entre connectivité SAS, connectivité SATA et intégration NVMe. Elles peuvent construire une architecture plus progressive, mieux adaptée aux contraintes de performance réelle, de capacité utile et de tolérance de panne. Dans ce cadre, il ne remplace pas automatiquement tous les autres choix, mais il devient un point d'ancrage logique pour les serveurs amenés à évoluer sans rupture technique majeure.

Convergence des protocoles de stockage en datacenter

Dans un datacenter, la convergence des protocoles de stockage n'est plus un sujet théorique. Les plateformes doivent intégrer des profils de supports différents selon les charges applicatives, les contraintes de coût et les niveaux de service attendus. SAS reste présent pour sa robustesse et certaines exigences d'environnement critique. SATA conserve une place sur des usages capacitifs. NVMe s'impose sur les traitements où la latence et le parallélisme deviennent dominants. Le contrôleur Tri-Mode permet de faire cohabiter ces mondes sans imposer une rupture complète de l'architecture.

Cette convergence a un effet direct sur l'exploitation. Elle simplifie les trajectoires de migration, limite la multiplication des composants intermédiaires et permet de rationaliser le câblage, la supervision et les évolutions de plateforme. Elle facilite aussi des architectures hybrides où certaines données restent sur des supports à forte endurance ou à forte capacité, tandis que les jeux les plus sensibles sont déplacés vers des supports plus rapides.

Dans ce contexte, le contrôleur Tri-Mode devient un levier de standardisation technique plutôt qu'un simple accessoire de compatibilité.

Impact sur la performance et la pérennité des plateformes

L'impact d'un contrôleur Tri-Mode sur la performance doit être analysé avec nuance. Son avantage principal n'est pas de rendre tous les supports équivalents, mais de permettre leur intégration sans verrouiller trop tôt l'architecture autour d'un seul protocole. Dans un serveur bien dimensionné, cela ouvre la possibilité d'affecter chaque type de média au bon niveau de charge, sans repenser intégralement la chaîne de connectivité à chaque évolution.

Sur le plan de la pérennité, cet aspect est déterminant. Une plateforme équipée d'un contrôleur Tri-Mode peut absorber une modernisation progressive, par exemple en introduisant davantage de NVMe tout en conservant des ensembles SAS ou SATA là où ils restent pertinents. Cela allonge la durée d'usage du serveur, réduit le risque de remplacement imposé par une limitation de connectique et maintient une meilleure maîtrise du cycle d'investissement.

Pour des décideurs techniques, l'intérêt est clair : réduire les impasses d'architecture. Le contrôleur Tri-Mode devient central parce qu'il aligne mieux performance réelle, souplesse d'évolution et conservation de la valeur des plateformes existantes.